想象一下,你正在学习开车。除了要掌握方向盘的操控,你还需要同时观察路况、识别交通标志、注意行人动向。这种"一心多用"的能力,恰恰就是多任务学习(Multi-task Learning)想要赋予人工智能的超能力。

网页版:https://hojivodb.gensparkspace.com/

视频版;https://www.youtube.com/watch?v=rw5S_6mKg2k

音频版:https://notebooklm.google.com/notebook/8d8a5c76-7833-48be-b8ef-294ea2d18ca5/audio

从人类学习到机器智能的启发

还记得小时候学骑自行车的经历吗?当你掌握了平衡技巧后,学习骑摩托车就变得相对容易。这种技能的迁移,正是多任务学习的核心思想。正如Sebastian Ruder在其开创性综述中所说:"多任务学习通过利用相关任务训练信号中包含的领域特定信息来提高泛化能力"。

在传统的单任务学习中,我们为每个任务训练独立的模型,就像培养只会做一件事的"专家"。但多任务学习打破了这种局限,它让一个模型同时学习多个相关任务,就像培养一个全能的"通才"。

两种经典的参数共享策略

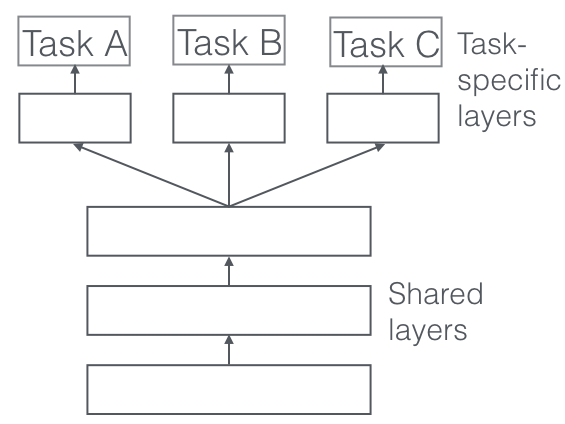

硬参数共享:完全的"共产主义"

硬参数共享是最直接的方式,就像一个大家庭里的兄弟姐妹共用一个书房。所有任务共享相同的隐藏层参数,只在输出层有各自的"专属空间"。

这种方法的优势显而易见:它大大减少了过拟合的风险。Baxter的理论研究表明,当有N个任务时,共享参数的过拟合风险比任务特定参数小N倍。就像一个班级里学生越多,老师的教学方法就越需要具有普遍适用性。

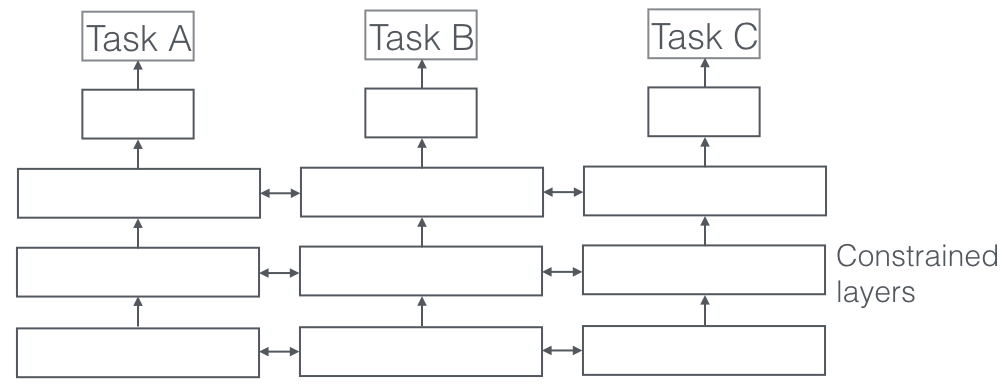

软参数共享:优雅的"约束"

软参数共享则更像是住在同一个小区的邻居,每家都有自己的房子,但建筑风格要保持一致。每个任务都有自己的参数,但通过正则化项来鼓励参数的相似性。

Duong等人的研究使用L2范数来约束不同任务参数间的距离,确保它们不会偏离太远。这就像给每个任务一根"弹性绳索",既允许自由发挥,又保持彼此间的联系。

自动驾驶:多任务学习的完美试验场

自动驾驶可能是多任务学习最激动人心的应用场景。想象一下,一辆车在城市道路上行驶时需要同时处理多少信息:

- 识别交通标志

- 检测行人和其他车辆

- 分析道路状况

- 预测其他交通参与者的行为

Tesla的Andrej Karpathy在其著名的演讲中展示了如何用一个统一的神经网络处理这些任务。最新的研究表明,实时多任务网络可以同时处理单目3D物体检测、语义分割和密集深度估计,这在传统单任务方法中是不可想象的。

这种方法的美妙之处在于任务间的相互促进。路标识别的特征可以帮助行人检测,而深度估计的信息又能提升物体检测的准确性。就像一个经验丰富的老司机,各种驾驶技能已经融为一体,形成了直觉般的反应。

NLP中的多任务魔法

在自然语言处理领域,多任务学习同样展现出了惊人的能力。考虑这样一个场景:你正在分析用户的产品评论,需要同时判断情感倾向和提取用户意图。

传统方法需要训练两个独立的模型:

- 情感分析模型:判断"这个产品太棒了!"是积极情感

- 意图识别模型:理解用户想要"购买"这个产品

但多任务学习让一个模型同时掌握这两种能力。研究表明,情感分析和意图识别共享大量的语言理解基础,比如词汇语义、句法结构等。当模型学会识别"太棒了"这个词的积极情感时,它也在学习这个词在意图表达中的作用。

负迁移:多任务学习的"阴暗面"

然而,多任务学习并非总是带来好处。有时候,不相关的任务会互相干扰,这就是所谓的"负迁移"现象。

想象一下,如果你试图同时学习中文和阿拉伯语,由于两种语言的书写方向完全不同,可能会产生混乱。在机器学习中也是如此。最新研究开发了一种通过代理建模来识别负迁移的方法,可以预测多个源任务对目标任务的影响。

这项研究发现,当任务间的相关性较低时,强制共享参数可能会损害性能。就像让一个专业的钢琴家同时练习架子鼓,两种技能的要求可能会相互冲突。

实现多任务学习的技术挑战

任务平衡的艺术

在多任务学习中,如何平衡不同任务的重要性是一个关键问题。Kendall等人的研究提出了基于不确定性的损失函数加权方法,通过学习每个任务的不确定性来自动调整权重。

这就像一个优秀的指挥家,需要平衡管弦乐队中不同乐器的音量,确保每个声部都能被恰当地听到。

梯度冲突的解决方案

当不同任务的梯度方向相冲突时,会导致训练不稳定。研究人员提出了"梯度手术"等方法来解决这个问题,通过调整梯度方向来避免任务间的相互干扰。

多任务学习的未来展望

随着Transformer架构的普及,多任务学习正在迎来新的发展机遇。最新的研究表明,注意力机制可以自动学习任务间的关联性,动态调整共享模式。

这种"任务感知"的注意力机制,就像一个智能的交通管制系统,能够根据实时情况调整不同道路的通行权重。

总结:共享智能的未来

多任务学习代表了人工智能发展的一个重要方向:从专用走向通用,从孤立走向协作。它不仅提高了模型的效率和性能,更重要的是为我们展示了一种新的学习范式。

正如人类通过跨领域的知识迁移来快速掌握新技能一样,多任务学习让AI系统能够在任务间建立联系,形成更加丰富和灵活的智能。虽然负迁移等挑战仍然存在,但随着技术的不断进步,我们有理由相信多任务学习将在未来的AI系统中发挥越来越重要的作用。

在这个AI与人类共同进步的时代,多任务学习可能正是我们通往通用人工智能的重要一步。它教会我们,有时候最大的智慧不在于专精,而在于整合和协调。