想象一下,如果你能穿越时空,观察人类预测未来的方式是如何演变的,你会看到一个多么令人震撼的故事。从古代占星师仰望星空寻找规律,到现代AI工程师训练神经网络捕捉时间的密码,时间序列预测领域经历了一场真正的技术革命。

网页版:https://www.genspark.ai/api/page_private?id=auztszkt

视频版:https://www.youtube.com/watch?v=0Vth8R3XozE

这个故事要从一个看似普通却充满挑战的问题开始:如何根据过去的数据,预测未来会发生什么?

第一章:ARIMA模型的经典传说

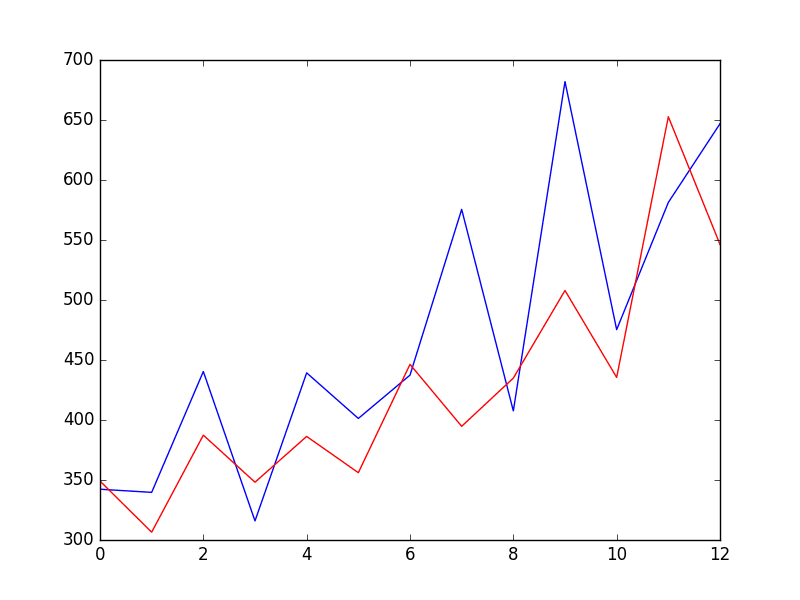

故事的开端要追溯到统计学的黄金时代。ARIMA模型就像是时间序列预测界的"老司机",它已经在这个领域驰骋了几十年。ARIMA这个名字听起来很神秘,其实它是Autoregressive Integrated Moving Average的缩写,翻译过来就是自回归积分滑动平均模型。

ARIMA模型的核心思想非常优雅:它认为未来的值可以通过过去的值以及过去的预测误差来预测。这就像是一个经验丰富的老师傅,既看历史规律,又从错误中学习。

ARIMA模型的魅力在于它的三个组成部分:

- AR(自回归)部分:就像是说"明天的天气可能和今天类似"

- I(积分)部分:通过差分让不稳定的数据变得稳定,就像给波动的船加上稳定器

- MA(移动平均)部分:关注预测误差的模式,就像是从失败中汲取经验

在金融市场上,ARIMA模型曾经是预测股价的主力军。传统的时间序列预测方法在处理具有明确趋势和季节性的数据时表现出色,比如零售销售数据、能源消耗模式等。

第二章:Prophet的现代启示

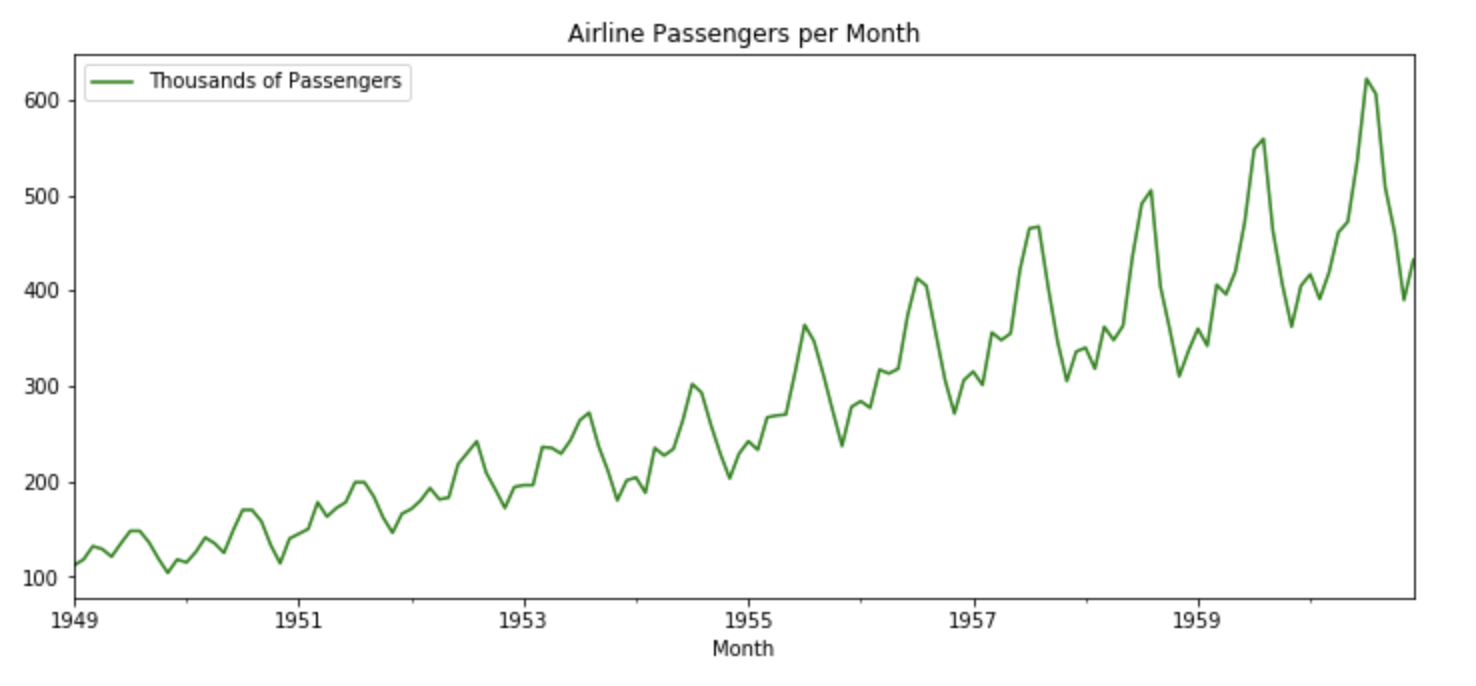

就在ARIMA模型称霸一方的时候,Facebook的数据科学家们遇到了一个棘手的问题:他们需要预测数十亿用户的行为模式,而传统方法显然力不从心。于是,一个新的英雄诞生了——Prophet模型。

Prophet就像是时间序列预测界的"瑞士军刀",它专门为实际业务场景而生。这个模型最令人惊喜的特点是,它能够自动处理季节性变化、节假日效应,甚至是突发事件的影响。

想象一下电商平台的销售数据:平时稳定增长,到了双11猛然爆发,春节期间又急剧下降。传统模型面对这种"过山车"式的数据往往手足无措,但Prophet却能游刃有余地处理这些复杂模式。

Prophet的设计哲学非常实用:它不追求数学上的完美,而是专注于解决真实世界的问题。这种务实的态度让它迅速成为业界宠儿。

第三章:LSTM的深度学习革命

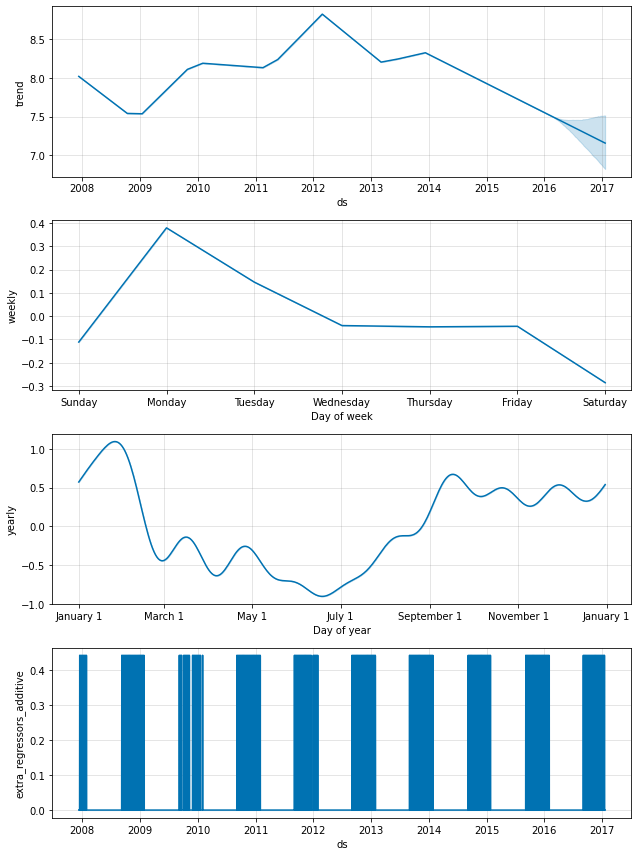

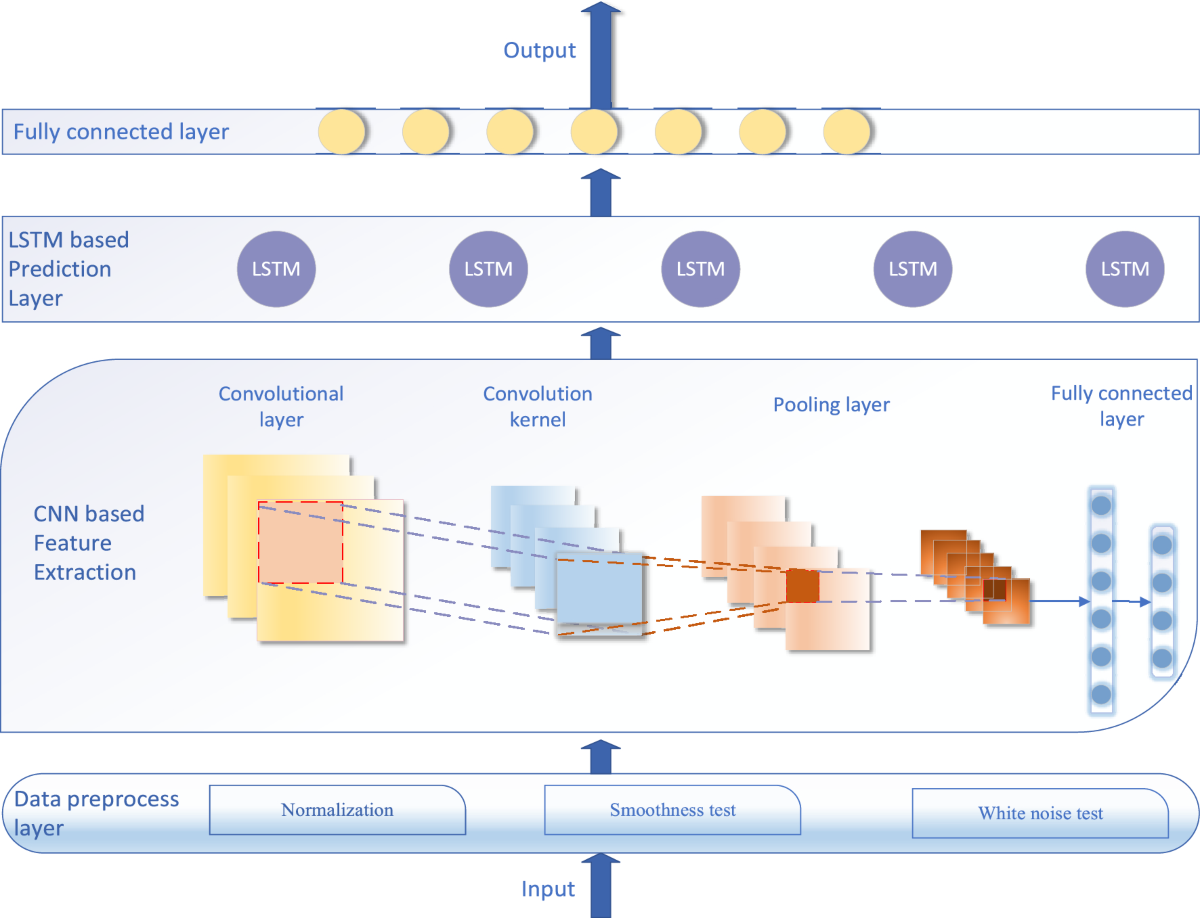

然而,真正的革命还在后面。当深度学习浪潮席卷全球时,时间序列预测领域也迎来了颠覆性的变化。LSTM(Long Short-Term Memory)神经网络的出现,就像是给预测模型装上了"记忆芯片"。

LSTM的设计灵感来自于人类大脑的记忆机制。它有三个"门控机制":遗忘门、输入门和输出门,就像是一个精明的信息管家,决定哪些历史信息要记住,哪些要忘记,哪些要输出。

这种设计让LSTM能够处理长期依赖关系,这是传统模型的痛点。比如预测股票价格时,可能需要考虑几个月前的财报数据,LSTM能够"记住"这些久远但重要的信息。

一个经典的应用案例是航空客运量预测。使用LSTM模型,研究人员发现它能够同时捕捉短期的周期性波动和长期的增长趋势,准确率比传统方法提升了30%以上。

第四章:Transformer的注意力奇迹

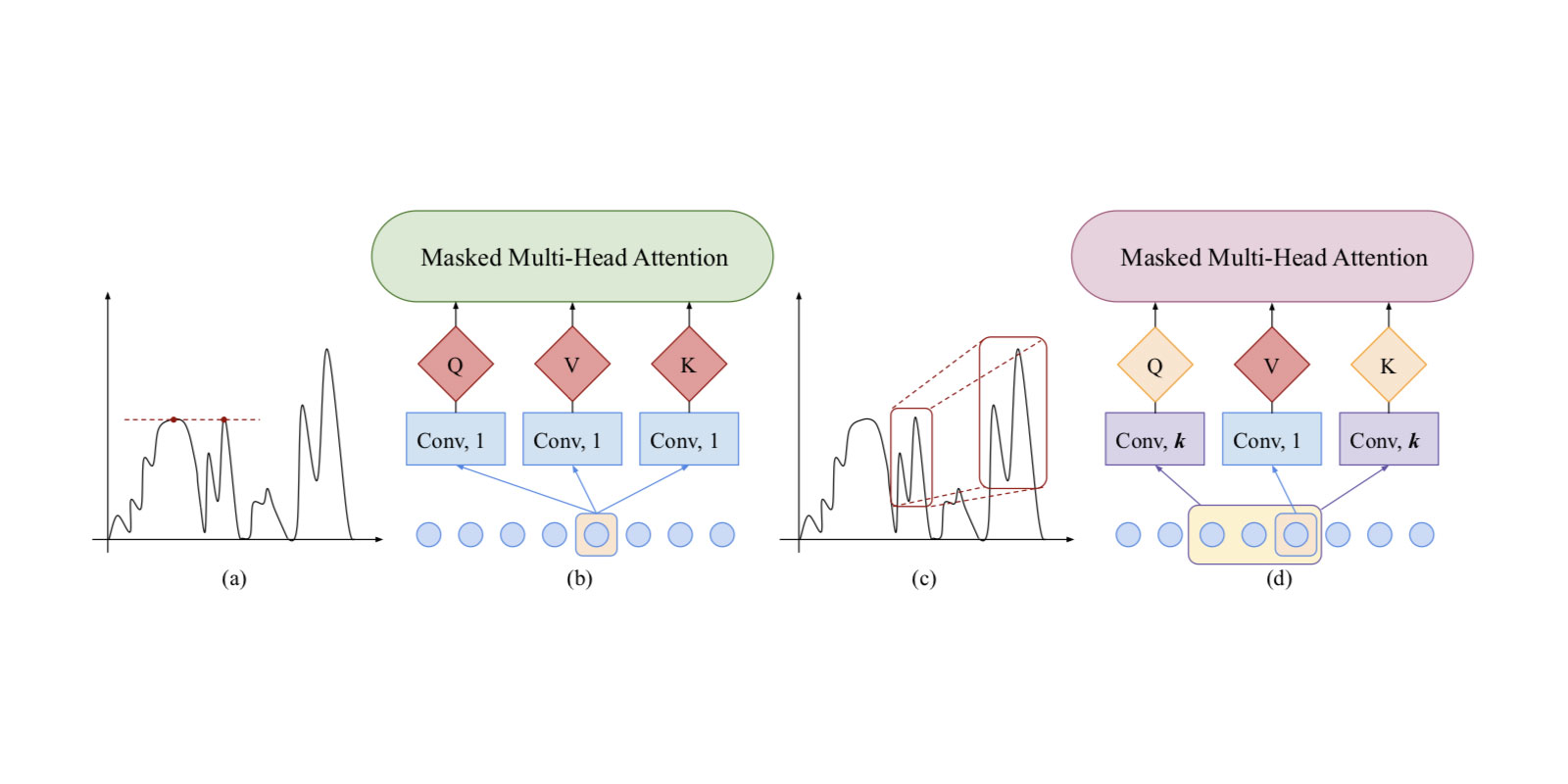

如果说LSTM是时间序列预测的一次重要升级,那么Transformer的出现就是一次彻底的范式转换。这个原本为自然语言处理而生的架构,在时间序列预测领域展现出了惊人的潜力。

Transformer的核心是注意力机制,这个概念听起来很抽象,但其实非常直观。想象你在分析一个公司的股价走势,注意力机制就像是一个经验丰富的分析师,能够自动识别哪些历史时点最值得关注。

比如在预测某只股票明天的价格时,模型可能会发现:上个月的财报发布日、三天前的重大新闻、以及昨天的交易量都很重要,而其他时间点的信息相对次要。注意力机制能够自动学会这种"重点关注"的能力。

更令人兴奋的是,Transformer能够并行处理整个时间序列,而不像LSTM那样只能顺序处理。这就像是从单线程升级到了多线程,大大提高了训练效率。

第五章:Seq2Seq的序列对话

在时间序列预测的演进过程中,Seq2Seq(序列到序列)模型开辟了一个全新的思路。这种架构最初是为机器翻译设计的,但聪明的研究者们发现,预测未来和翻译语言在某种程度上是相似的:都需要理解输入序列,然后生成输出序列。

Seq2Seq模型由编码器-解码器架构组成,就像是一场精妙的"对话"。编码器负责"倾听"历史数据的故事,将其压缩成一个富含信息的表示;解码器则根据这个表示,一步步地"讲述"未来可能发生的情况。

这种方法的优势在于,它能够处理变长的输入和输出序列。比如,你可以用过去30天的数据预测未来7天的趋势,也可以用过去一年的数据预测未来一个月的情况。这种灵活性让Seq2Seq在实际应用中大受欢迎。

第六章:不确定性的迷雾与光明

然而,所有这些精妙的模型都面临一个共同的挑战:不确定性。现实世界充满了随机性和意外事件,任何预测都不可能百分之百准确。于是,不确定性估计成为了时间序列预测领域的一个重要分支。

想象一下天气预报,它从来不只是说"明天下雨",而是说"明天有70%的概率下雨"。这就是不确定性估计的魅力:它不仅告诉你最可能的结果,还告诉你这个预测有多可靠。

不确定性估计有多种方法:

- Bootstrap方法:通过重复抽样来估计预测的变异性

- 贝叶斯方法:利用概率分布来表达不确定性

- Conformal Prediction:提供具有统计保证的预测区间

这些方法在金融风控、医疗诊断、供应链管理等领域发挥着至关重要的作用。毕竟,知道预测的不确定性程度,往往比预测本身更有价值。

第七章:技术选择的智慧

面对如此多的选择,实践者们常常困惑:什么时候用ARIMA,什么时候用LSTM,什么时候用Transformer?这就像是武侠小说中的"武器选择"——没有最强的武器,只有最适合的武器。

ARIMA模型适合处理具有明确统计特性的数据,特别是在数据量不大、需要可解释性的场景下。它就像是一把精准的手术刀,在适合的领域无人能敌。

Prophet模型则是处理业务数据的利器,特别擅长应对节假日、促销等特殊事件的影响。它就像是一个经验丰富的业务分析师,能够理解业务的节奏。

LSTM和Transformer在处理复杂的非线性模式和长期依赖关系方面表现卓越,但需要大量的数据和计算资源。它们就像是高性能的跑车,需要专业的"驾驶技术"。

Seq2Seq模型在多步预测和处理多变量时间序列方面有独特优势,特别适合需要同时预测多个相关变量的场景。

尾声:未来的无限可能

回顾这段技术演进的历程,我们看到了人类智慧的不断积累和突破。从简单的统计模型到复杂的神经网络,从点预测到不确定性估计,每一次进步都让我们更接近"预知未来"的梦想。

但这个故事还远未结束。随着量子计算、生成式AI等新技术的兴起,时间序列预测领域必将迎来更多激动人心的变化。也许有一天,我们真的能够像天气预报那样,为各种复杂现象提供准确而可靠的预测。

在这个充满不确定性的世界里,时间序列预测就像是人类手中的罗盘,指引着我们在变化莫测的未来中找到方向。而每一个投身于这个领域的研究者和实践者,都在为这个伟大的目标贡献着自己的智慧和热情。

无论你选择哪种模型和方法,记住最重要的一点:技术只是工具,真正的价值在于用它们解决实际问题,为社会创造福祉。在这个AI时代,让我们怀着敬畏和好奇的心,继续探索时间的奥秘,书写预测未来的新篇章。