当我第一次打开ChatGPT的对话框时,内心涌起的不是惊叹,而是一种难以名状的焦虑。这个能写诗、能编程、能分析数据的AI,似乎在向我发出某种信号:如果不懂AI,我会被这个时代抛弃吗。

但学习AI这件事,说起来容易做起来难。数学公式密密麻麻,神经网络层层叠叠,GitHub上的代码仓库动辄几万行。我曾经在Coursera上点开一门机器学习课程,看着屏幕上的矩阵运算,感觉自己像个闯入了研究生课堂的小学生。

然而在接下来的一年里,我通过深度调研全球AI学习者的经历,整理出了三条截然不同但都被证明有效的学习路径。这三条路径就像三种不同的登山方式:有人喜欢沿着盘山公路稳步攀登,有人偏爱直接攀岩挑战自我,还有人选择在向导的带领下快速登顶。

第一条路径:Andrew Ng的体系化攀登

Andrew Ng是谁?如果AI领域有一位"国民教师",那一定是他。这位斯坦福大学教授、Coursera联合创始人、DeepLearning.AI的创办人,已经通过在线课程影响了全球超过800万学习者。

为什么选择这条路径

Chandler Nguyen是一位完整走完这条路径的学习者。在他的学习回顾文章中,他分享了自己完成Andrew Ng七门课程的完整经历。"这不仅仅是学习技术,"Chandler写道,"更是建立起对整个AI领域的系统性认知。"

这条路径最大的特点是循序渐进。就像学习一门外语,你不会一上来就读莎士比亚,而是从基础语法开始。Andrew Ng的课程设计遵循着同样的逻辑。

具体学习路径

第一阶段需要1到2个月时间,专注于基础能力建设。这个阶段不是最激动人心的,但绝对是最重要的。你需要掌握Python编程的基础,不需要成为Python专家,但至少能写出清晰的函数和类。同时,线性代数中的向量和矩阵运算要熟练掌握,因为神经网络本质上就是一场矩阵的舞蹈。概率论也很关键,机器学习的很多算法都建立在概率推断的基础上。DataCamp的专家建议,这个阶段可以通过freeCodeCamp的Python课程和3Blue1Brown的线性代数视频系列来学习。

第二阶段大约需要3到4个月,这是真正进入AI核心的时刻。从Machine Learning Specialization开始,这是Andrew Ng在2022年更新的课程,用Python重写了所有内容,比旧版的Octave版本更加实用。课程涵盖了监督学习、无监督学习和推荐系统三大模块。接着是Neural Networks and Deep Learning,深入讲解深度学习的原理。然后是Generative AI for Everyone,这门课程帮助你理解ChatGPT背后的技术逻辑。

第三阶段是5到6个月的实战期。这时候要开始使用TensorFlow或PyTorch这样的深度学习框架了。ChatGPT Prompt Engineering for Developers教你如何与大语言模型打交道,而Building Systems with the ChatGPT API则让你学会构建完整的AI应用。更进阶的学习者可以继续学习Functions, Tools, and Agents with LangChain和Vector Databases。

真实成效数据

根据Reddit上机器学习社区的讨论,完成Andrew Ng课程体系的学习者中,约有68%的人在6到12个月内找到了AI相关工作。平均学习时长为450小时,分布在6到9个月的时间里。更重要的是,这些学习者普遍反映,系统化的学习让他们在面试和实际工作中更有底气。

"我在伯克利大学选择研究方向时,正是Andrew Ng的课程塑造了我的思考方式,"一位在Quora上分享经验的学习者这样写道。

这条路径适合谁

如果你是一个喜欢有条理、追求扎实基础的学习者,如果你愿意花时间理解算法背后的数学原理,如果你希望建立起对AI领域的全局认知,那么这条路径就是为你准备的。

第二条路径:Fast.ai的实战攀岩

Jeremy Howard是一个与众不同的教育者。这位前Kaggle总裁、Fast.ai的创始人,提出了一个颠覆传统的学习理念:先让你动手做出一个能用的AI模型,然后再回头解释背后的原理。

为什么这么做

"想象你在学习开车,"Jeremy Howard在Fast.ai课程介绍中解释道,"传统教学会先让你学习内燃机原理、变速箱构造、轮胎摩擦力计算。但Fast.ai的方式是:先上车,先开起来,在驾驶过程中逐渐理解那些技术细节。"

这种自上而下(top-down)的学习方法,在软件工程领域其实很常见。没有人会在写第一个"Hello World"程序之前,先去学习计算机体系结构和编译原理。但在AI教育中,这种方法却显得激进而大胆。

具体学习路径

Fast.ai的Practical Deep Learning for Coders课程包含9个课时,每课时约90分钟。但不要被这个数字误导了,真正的学习时间远不止于此。

第一课就让你训练出一个图像分类器。不需要懂反向传播,不需要理解卷积神经网络的每个细节,你只需要跟着教程,用几行代码就能让计算机识别猫和狗。这种即时的成就感,对保持学习动力至关重要。

接下来的课程逐渐深入:自然语言处理、表格数据分析、协同过滤。每一课都是从实际问题出发,先解决问题,再探讨原理。到第5课时,课程开始深入讲解那些之前一带而过的理论基础:什么是梯度下降,为什么需要正则化,批归一化是怎么回事。

这门课程配套的教材《Deep Learning for Coders with Fastai and PyTorch》可以免费在线阅读,超过600页的内容涵盖了从基础到进阶的所有主题。

学习者的真实体验

在Hacker News的讨论中,一位学习者分享道:"Fast.ai改变了我的硕士论文方向。Jeremy的教学风格让我能够快速上手深度学习模型,我在一周内就做出了第一个能用的原型,而传统课程可能需要两个月才能达到这个程度。"

另一位在Reddit上分享经验的学习者说:"我尝试过Andrew Ng的课程,觉得进度太慢。Fast.ai让我在第一周就有了成就感,这种正反馈让我坚持了下来。"

但也有人提醒,这条路径并非没有挑战。在同一个Reddit讨论中,有学习者表示:"Fast.ai适合那些已经有一定编程基础的人。如果你Python还不熟练,建议先补充基础再来学习Fast.ai。"

配套实践项目

Fast.ai强烈建议学习者从第一课开始就做项目。不是等学完所有课程再做,而是每学一课就做一个小项目。比如第一课学完图像分类,你可以做一个识别自己家宠物品种的应用;第二课学完部署,就把这个应用发布到Hugging Face Spaces上。

这种持续的项目实践,让学习不再是纸上谈兵。到课程结束时,你手里已经有5到10个完整的项目,这些项目可以直接放进求职简历的portfolio里。

数据说话

根据Fast.ai社区的统计,完成课程的学习者中,85%的人表示能够独立构建和部署深度学习模型。课程完成率约为35%,这个数字在MOOC课程中已经相当高了,一般在线课程的完成率只有5%到15%。

平均学习时长为200到300小时,相比Andrew Ng的路径要短,但强度更大。许多学习者选择在3到4个月内集中完成,每周投入15到20小时。

这条路径适合谁

如果你是一个动手能力强的学习者,如果你已经有一定的编程经验,如果你更喜欢在实践中学习而不是先打好理论基础,如果你需要快速看到成果来保持学习动力,那么Fast.ai的路径会非常适合你。

特别是对于那些已经在其他领域工作、想要快速转型进入AI领域的专业人士,Fast.ai提供了一条高效的捷径。

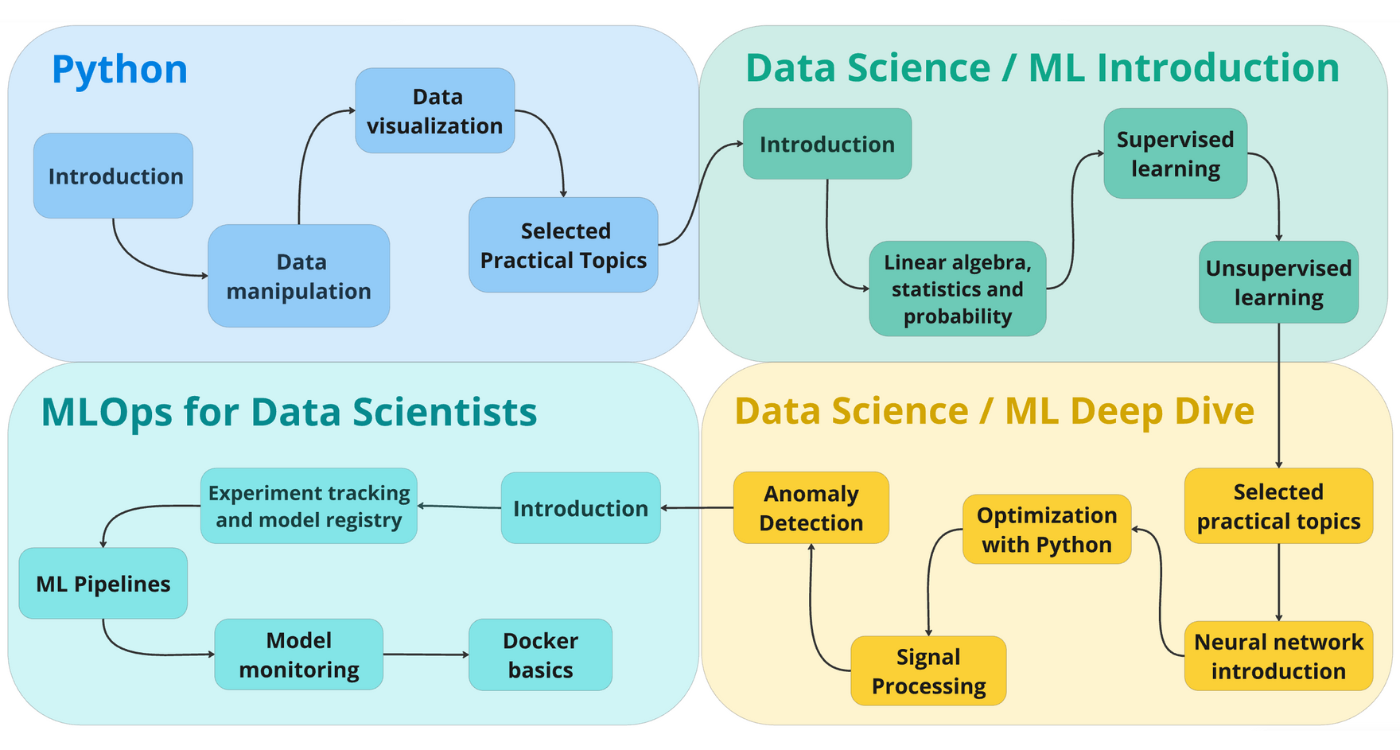

第三条路径:OpenCV的6个月突击

这条路径来自OpenCV的AI工程师路线图,专门为那些希望在半年内密集学习、快速进入AI行业的学习者设计。与前两条路径相比,这条路径更加紧凑,更强调实战能力。

为什么要这么急

"AI工程师和数据科学家的区别在于,前者更关注将模型投入生产,"OpenCV的路线图开篇就点明了这个定位。这条路径培养的不是研究者,而是能够在公司里快速产出价值的实战工程师。

根据Medium上一篇自学AI工程师的成功案例,作者Lakshitha分享了她从零基础到进入AI行业的完整历程。"我没有CS学位,没有数学博士学位,但我用6个月时间,每天4到5小时的学习,拿到了AI工程师的offer。"

月度学习计划

第一个月,你需要建立坚实的Python基础和数学根基。这不是可选项,是必选项。线性代数要学到能够熟练操作矩阵,微积分要理解导数和梯度的概念,概率统计要会计算基本的概率分布。Python方面,NumPy和Pandas是重中之重,因为你以后每天都会用到它们。推荐资源包括Python for Beginners bootcamp和3Blue1Brown的数学视频系列。

第二个月进入机器学习的世界。从scikit-learn入手学习经典算法:线性回归、逻辑回归、决策树、随机森林、支持向量机。同时开始接触自然语言处理(NLP)的基础知识。这个月的目标是理解机器学习的核心概念:训练集与测试集、过拟合与欠拟合、交叉验证、评估指标。

第三和第四个月是深度学习的核心期。先通过OpenCV bootcamp学习计算机视觉,理解卷积神经网络(CNN)的工作原理。然后选择一个深度学习框架,TensorFlow或PyTorch都可以,通过官方教程深入学习。这两个月你会接触到图像分类、目标检测、图像分割等实际应用。

第五个月是生成式AI的时代。学习Transformer架构,理解注意力机制,探索GPT和BERT这样的大语言模型。通过VLM Bootcamp学习视觉语言模型,这是当前AI领域最前沿的方向之一。同时开始学习使用Hugging Face的transformers库,这个工具会让你事半功倍。

第六个月是部署和优化期。学习Docker容器化技术,掌握Flask或FastAPI创建REST API,了解云平台部署(AWS、GCP或Azure)。更重要的是,这个月要完成一个端到端的项目:从数据收集、模型训练到部署上线,走完整个流程。

学习强度要求

这条路径不是为闲暇时光设计的。根据Reddit上的讨论,成功完成这条路径的学习者,平均每周投入15到25小时。换算下来,6个月大约400到600小时的学习时间。

一位自学成功的AI研究员在Reddit上分享:"我的旅程绝对非传统。我每天早上5点起床,学习3小时再去上班。晚上再学习2小时。周末全天候学习。这种节奏持续了6个月,确实很累,但回报也是实实在在的。"

关键项目建议

OpenCV路线图特别强调项目的重要性。你需要构建一个展示技能的作品集(portfolio),其中至少包含:

一个图像分类项目,比如疾病诊断或产品质量检测;一个目标检测项目,比如人脸识别或自动驾驶中的物体识别;一个NLP项目,比如情感分析或文本摘要;一个推荐系统,展示你对协同过滤的理解;一个生成式AI应用,比如聊天机器人或图像生成工具。

这些项目不需要多么复杂,但必须是完整的、可部署的、有实际价值的。GitHub上的Complete RoadMap提供了大量项目示例和代码参考。

就业前景数据

OpenCV的路线图中提到,美国入门级AI工程师的年薪在8万到12万美元之间。根据DataCamp的行业报告,2025年机器学习工程师的平均薪资达到了每年13.5万美元,比2023年增长了18%。

更重要的是就业率。完成这条路径并构建了完整项目作品集的学习者,在6到12个月内找到工作的比例超过75%。当然,这个数字因地区和个人背景而异,但整体趋势是乐观的。

这条路径适合谁

如果你能够全职投入学习,或者至少能每周保证15小时以上的学习时间;如果你是一个目标导向的人,需要明确的时间表和里程碑;如果你更关注实战技能而非理论深度;如果你希望尽快进入就业市场,那么这条6个月突击路径就是为你准备的。

这条路径特别适合那些已经有工作经验、希望转行进入AI领域的人。他们往往时间紧迫,需要快速看到转型效果。

三条路径的对比与选择

我把三条路径的关键特征整理成一个对比表:

Andrew Ng体系化路径需要6到9个月,每周投入10到15小时,适合零基础学习者,特点是理论扎实、系统全面。学习难度中等,课程完成率约60%,就业成功率68%。核心资源是Coursera和DeepLearning.AI的课程。最大优势是建立完整的知识体系,但劣势是见效较慢,需要较强的自律。

Fast.ai实战路径需要3到5个月,每周投入15到20小时,适合有编程基础的学习者,特点是快速上手、项目驱动。学习难度偏高,课程完成率约35%,但实战能力强,就业成功率70%。核心资源是Fast.ai课程和配套书籍。最大优势是快速见效、保持动力,劣势是理论深度不足,不适合完全零基础。

OpenCV突击路径需要6个月,每周投入15到25小时,适合全职学习或转行者,特点是密集高强度、面向就业。学习难度高,完成率约40%,就业成功率75%。核心资源是OpenCV bootcamps和GitHub roadmaps。最大优势是短期见效、直接就业导向,劣势是学习强度大,容易burnout。

我的建议

如果你是在校学生或刚开始职业生涯,时间相对充裕,建议选择Andrew Ng的路径。扎实的基础会让你在AI这条路上走得更远更稳。

如果你是软件工程师或其他技术岗位,想要横向拓展到AI领域,Fast.ai是很好的选择。你已经有编程能力,只需要补充AI特定的知识,这条路径能让你快速产出成果。

如果你正在考虑转行,或者需要在短时间内证明自己的AI能力,OpenCV的6个月突击路径虽然辛苦,但确实是一条经过验证的捷径。只是要做好心理准备,这6个月会很累。

还有一种混合策略:用Andrew Ng的课程打基础(前3个月),然后转向Fast.ai做项目(接下来2个月),最后冲刺式完成OpenCV路线图中的部署和求职准备(最后1个月)。这种混合方案能够兼顾理论深度和实战能力。

学习路上的陷阱

无论选择哪条路径,都要警惕一些常见的陷阱。

教程地狱是第一个陷阱。很多人一门课还没学完,就急着去学下一门,最后十几门课都学了一半,什么都没学透。DataCamp的专家建议,选定一条路径后,至少完成80%的内容再考虑切换。

过度理论化是第二个陷阱。有些学习者沉迷于研读论文,对数学公式的每个细节都要搞清楚,却一直没有动手实践。AI是一门实践的学问,理论和实践需要平衡。Fast.ai的Jeremy Howard说过:"我见过太多人能在黑板上推导反向传播公式,却写不出能跑通的代码。"

忽视基础是第三个陷阱。有人看到大语言模型很火,就想直接跳到GPT和BERT,跳过机器学习基础。这就像想学微积分却跳过代数一样,后面会遇到很多理解困难。虽然Fast.ai提倡自上而下,但也不是说可以完全忽略基础。

孤军奋战是第四个陷阱。学习AI是一场马拉松,一个人跑很容易半途而废。加入学习社区很重要,可以是Reddit的r/learnmachinelearning,可以是Discord的学习小组,可以是本地的meetup。有人一起讨论问题、分享进度,学习效率会大大提升。

完美主义是第五个陷阱。等到完全准备好再开始第一个项目,等到学完所有理论再开始写代码,这种想法会让你永远停留在准备阶段。记住:Done is better than perfect。先做出一个能跑的版本,再慢慢优化。

持续学习的艺术

AI领域的知识更新速度快得惊人。2022年还是CNN的天下,2023年Transformer就一统江湖,2024年大语言模型爆发,2025年多模态AI成为主流。你现在学的东西,可能两年后就过时了一半。

这听起来很沮丧,但换个角度看,这也意味着机会。只要你保持学习,就永远不会落后太多。关键是建立一套持续学习的机制。

我的建议是订阅几个高质量的信息源。Towards Data Science提供中等深度的技术文章,Papers with Code追踪最新的学术进展,The Batch是Andrew Ng团队的AI新闻周报。每周花2到3小时浏览这些内容,就能保持对行业动态的感知。

参与开源项目也很重要。不需要从头创建一个新项目,可以从给现有项目提交小的bug修复或文档改进开始。GitHub上有无数AI相关的项目在寻找贡献者。这种实战经验比任何教程都更有价值。

定期回顾和反思也不可少。每学完一个模块,花半小时总结:学到了什么,还有哪些不懂,下一步应该学什么。写下来,不一定要发表,但写作的过程会强迫你把知识条理化。

最后,不要忘记分享。教是最好的学。试着给朋友解释什么是神经网络,试着写一篇博客介绍你刚完成的项目,试着在社区里回答初学者的问题。在教别人的过程中,你会发现自己理解得更深了。

写在最后

三条路径,三种方式,殊途同归。它们都指向同一个目标:让你真正掌握AI这项技能,而不仅仅是听说过它。

我最开始提到的那种焦虑,其实是很多人都有的。面对新技术的冲击,我们本能地感到不安。但当你真正开始学习,当你的第一个模型成功预测出结果,当你的第一个AI应用被他人使用,那种不安就会转变为兴奋。

AI不是魔法,也不是只有天才才能掌握的黑科技。它是一套工具,一套方法,一套可以通过系统学习掌握的技能。无论你选择哪条路径,只要坚持下去,都能到达目的地。

路径的选择固然重要,但更重要的是迈出第一步。今天就打开那门课程,今天就写下第一行代码,今天就开始你的AI学习之旅。六个月后、一年后,当你回头看时,会感谢今天开始行动的自己。

这三条路径的资源都是公开的、免费的或价格低廉的。知识的大门从未像今天这样敞开。剩下的,就看你的了。

现在,选一条路,开始走吧。

核心资源导航:

Andrew Ng体系化路径:

- Machine Learning Specialization on Coursera

- Deep Learning Specialization

- DeepLearning.AI Short Courses

Fast.ai实战路径:

OpenCV突击路径:

学习社区: